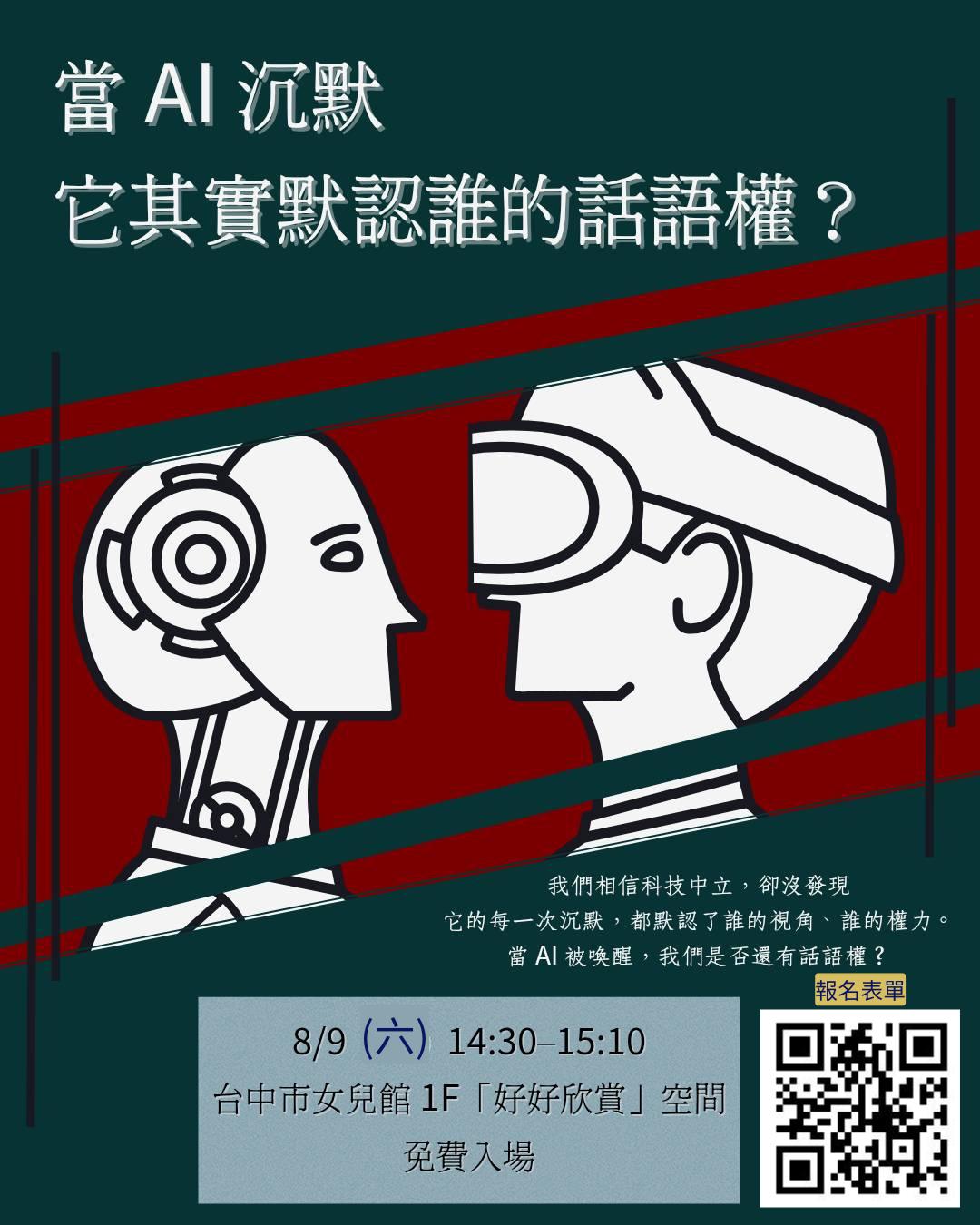

大家總以為 AI 沒有立場,但它其實默認某些人的話語

我們請它畫出醫生,

它遞上的,大多是白人男性;

我們詢問家庭主婦的模樣,

它回應的是亞洲女性與廚房。

這些答案,沒有惡意

AI 不會創造偏見,但它記得我們的偏見。

這場講座,我們將一起討論:

▸ AI 偏見從何而來?

▸ 使用者的行為如何放大偏見?

▸ 當我們選擇沉默,我們是否也默許了它的偏差?

如果 AI 也懂得反思,

它是否還會認為:

CEO 是男性,甜點是女生的興趣?

一位高中生,寫了一本給 AI 的「公平指南」。

她問:「既然你什麼都學,那可不可以學習尊重、多元與不預設?」

這不是技術開發的工程,而是一場日常裡的反偏見行動。

這場講座,我們將分享:

▸ 一名學生如何從使用者走向倡議者

▸ 策展、翻牌遊戲、ChatBot 與教案設計的實作歷程

▸ 為什麼我們的每一次輸入、搜尋、點擊,都是一種選擇?

AI 並不壞,它只是太乖,你怎麼問,它就怎麼學

那麼,你想教它什麼樣的世界?

活動相關疑問請私訊: @ai._.accomplice